Pourquoi confier votre relation assuré à une IA qui ignore vos contrats ? C’est exposer votre compagnie à un risque que votre direction juridique n’a pas encore chiffré.

L’illusion du chatbot « prêt à l’emploi »

Depuis 2023, les directions générales des compagnies d’assurance ont toutes reçu le même pitch : « Déployez un chatbot GPT, réduisez vos coûts de support de 40 %. » Le discours est séduisant. Et pourtant, les directions juridiques tirent la sonnette d’alarme.

Car il y a une réalité que les éditeurs IA grand public occultent soigneusement : une IA générique ne connaît pas vos contrats. Elle ignore vos tableaux de garanties, vos clauses d’exclusion, vos règles de souscription maison. Et dans le secteur de l’assurance, une réponse approximative n’est pas une maladresse, c’est une faute professionnelle.

Anatomie d’un risque que votre DSI ne voit pas

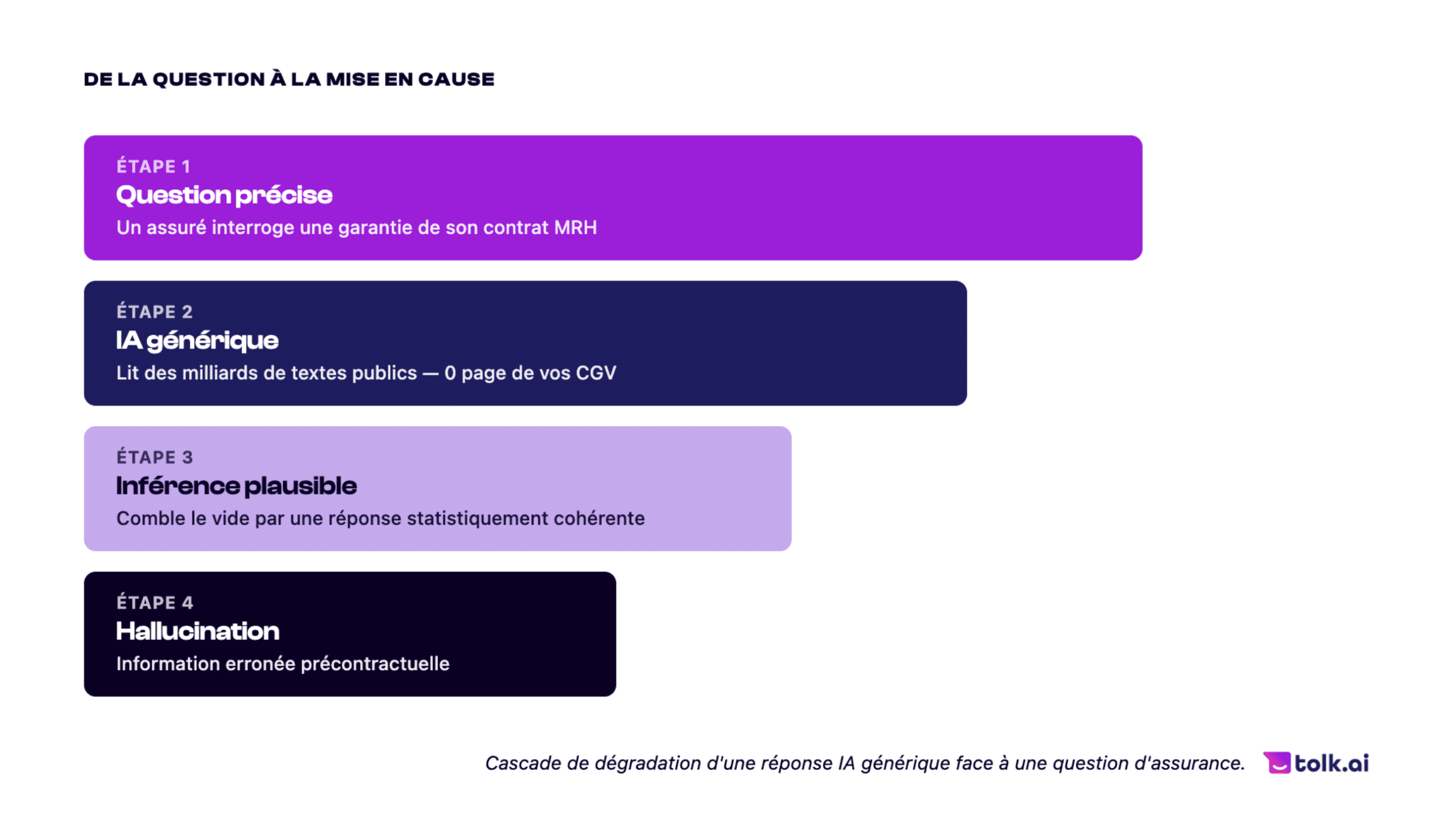

Les LLM génériques sont entraînés sur des milliards de textes publics. Ils sont capables de produire des réponses fluides et plausibles. Mais face à une question précise d’un assuré, ils comblent leurs lacunes par inférence. Ils « hallucinent », et dans l’assurance, une hallucination a un nom juridique : information erronée précontractuelle.

Ce funnel de risque n’apparaît dans aucun rapport standard. Pourtant, c’est là que se jouent vos prochaines mises en cause.

1. Un chiffre qui dérange : 3 scénarios à exposition directe

Scénario A : Le conseil erroné sur une garantie.

Un assuré demande si son contrat MRH couvre le dégel de canalisations. L’IA répond positivement en se basant sur des formulations génériques du marché. Ce contrat précis exclut ce sinistre dans une clause peu visible. L’assuré ne déclare pas en urgence. Le sinistre s’aggrave.

Dans votre dashboard : session résolue, ticket fermé, 0 escalade. Réalité : mise en cause pour information erronée.

Scénario B : L’engagement non validé.

Un prospect interroge le chatbot sur une extension de garantie. L’IA confirme une couverture absente de l’offre standard. Il signe. Lors du sinistre, le refus de prise en charge génère une réclamation formelle. Selon la DDA, la responsabilité de l’information précontractuelle incombe à la compagnie, pas au prestataire technologique.

Scénario C : La fuite de données.

La plupart des LLM grand public sont hébergés aux États-Unis et soumis au Cloud Act. Vos données de santé, patrimoniales et sinistres (toutes classifiées sensibles par le RGPD) transitent sur des serveurs hors souveraineté européenne.

2. Le diagnostic : pourquoi vos outils actuels vous exposent

Si vous avez déjà un chatbot ou une FAQ, vous pensez être couvert. C’est souvent l’inverse.

Le chatbot IA générique ne connaît pas vos CGV. Il ne connaît pas vos conditions particulières ni vos avenants. S’il ne sait pas, il ne dit pas « je ne sais pas », il répond quand même avec une confiance statistique que votre assuré interprétera comme une garantie contractuelle.

La FAQ statique, elle, demande à l’assuré de quitter son tunnel pour lire 2 000 mots. Personne ne veut chercher une information : tout le monde veut recevoir une réponse.

3. Le cadre réglementaire qui change la donne

Trois textes créent des obligations directes sur la qualité de l’information délivrée, y compris par vos IA :

- La DDA (2016/97/UE) impose que toute information précontractuelle soit claire, exacte et non trompeuse. Les canaux automatisés ne sont pas exemptés.

- L’ACPR a publié en 2023 ses premières orientations sur l’IA dans les services financiers : traçabilité des décisions automatisées et capacité d’audit en tête.

- L’AI Act classe les systèmes d’IA utilisés pour conseiller en assurance en catégorie risque élevé : documentation, transparence et supervision humaine obligatoires. Découvrez notre article sur le sujet.

Ces textes ne sont pas théoriques. Les premières sanctions émergent au niveau européen. Ce sujet n’est plus une préoccupation de DSI, c’est un enjeu stratégique clé.

4. L’impact business : précision comme avantage concurrentiel

Par ailleurs, les assureurs qui intègrent l’IA de manière rigoureuse enregistrent des gains mesurables. La différence ne tient pas au modèle LLM choisi, elle tient à l’architecture.

Les solutions performantes ancrent le LLM strictement dans votre corpus documentaire via une technique appelée RAG (Retrieval-Augmented Generation). L’IA ne peut répondre qu’à partir de ce que vous lui avez fourni. Elle cite ses sources. Si elle ne sait pas, elle le dit.

- 80 % de questions de niveau 1 automatisées et traitées sans intervention humaine,

- Chaque interaction tracée et auditable pour répondre aux exigences ACPR,

- Données sur infrastructure souveraine, hors de portée du Cloud Act,

- +25 % de leads qualifiés sur les parcours de souscription avec agent contextuel (benchmarks sectoriels assurance IA 2025).

Vos CGV ont 80 pages. Votre IA générique en a lu 0.

En conclusion, le risque de l’IA générique en assurance n’est pas un risque technologique, c’est un risque juridique et réputationnel que votre comité de conformité n’a pas encore intégré dans sa cartographie.

Enfin, les compagnies qui déploieront une IA ancrée sur leurs données métier en 2026 n’auront pas seulement réduit leurs coûts de support. Elles auront transformé leur relation assuré en avantage concurrentiel défendable.

Dans notre prochain article, nous explorerons comment passer du traitement de l’information à l’exécution automatisée : pourquoi le futur de la relation assuré ne réside plus seulement dans la résolution des tickets support.